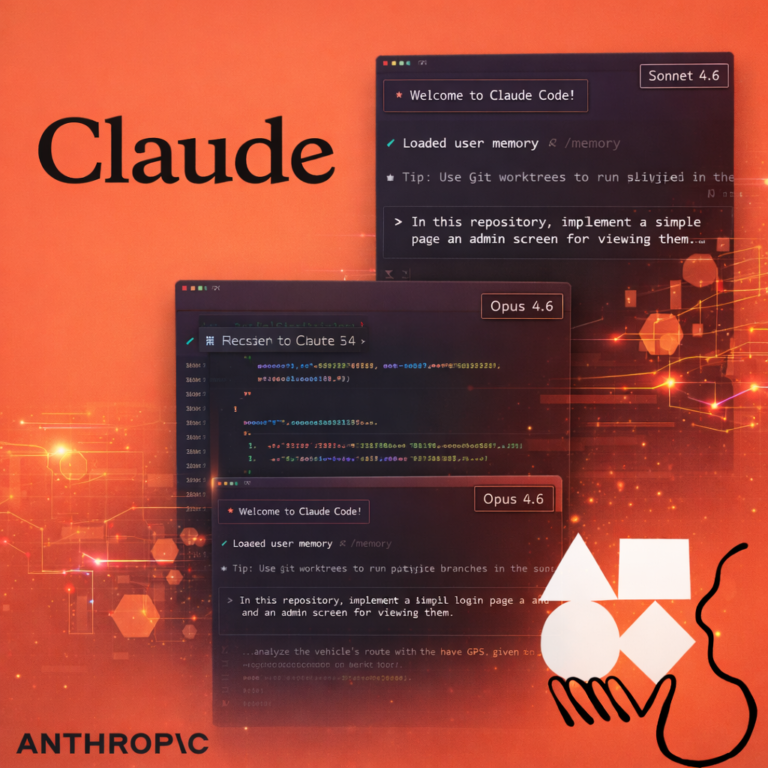

A finales de enero de 2026, Google dejó bastante clara su estrategia con Gemini: ya no quiere que lo veas como una app a la que entras cuando necesitas algo puntual. Quiere convertirlo en una capa transversal de ayuda, contexto y automatización que te acompañe en el navegador, en el móvil y en tus servicios de Google.

El resumen de novedades de enero fue una señal muy potente en esa dirección. Google presentó Personal Intelligence, mejoró Gemini dentro de Chrome con funciones de automatización como Auto Browse, reforzó herramientas de estudio y aprendizaje, y siguió empujando funciones creativas como generación de vídeo desde imágenes. Visto en conjunto, enero dejó una idea muy clara: Google no está construyendo solo un chatbot, está intentando convertir Gemini en la interfaz principal entre tú y su ecosistema digital.

Gemini ya no quiere responderte: quiere conocerte

La novedad más llamativa del mes fue Personal Intelligence, una función beta que permite conectar Gemini con apps y servicios de Google como Gmail, Google Photos, YouTube y Search. La idea es sencilla, pero potente: que Gemini deje de responder solo con información general y empiece a ayudarte con contexto real sobre tu vida digital.

Eso significa que, si lo activas, Gemini puede ayudarte a organizar un viaje revisando correos de reservas, recuperar una foto concreta de hace meses sin que tengas que buscarla a mano, resumir temas que viste en YouTube o ayudarte con ideas y planes basados en tu historial. Google insiste en que es opcional, que tú decides qué conectas y que el control sigue en manos del usuario. Pero más allá del discurso de privacidad, lo importante aquí es otra cosa: Google quiere que su IA te conozca lo suficiente como para ser útil de verdad sin que tengas que explicarle todo cada vez.

Esto cambia bastante el papel de Gemini. Ya no sería solo un asistente que responde preguntas. Empieza a parecerse más a una mezcla entre agenda, copiloto personal, buscador contextual y memoria digital.

Chrome deja de ser un navegador pasivo

La otra gran novedad de enero fue la integración de Gemini dentro de Chrome, especialmente con la función Auto Browse. Y aquí Google está apuntando muy alto.

Auto Browse permite pedirle a Gemini que haga tareas dentro del navegador: buscar productos, comparar opciones, navegar entre webs, rellenar pasos básicos o ayudarte a encontrar lo que necesitas sin que tú tengas que abrir veinte pestañas y hacerlo todo manualmente. Google lo explicó con ejemplos bastante cotidianos: organizar una fiesta, buscar artículos parecidos a una foto, encontrar descuentos o volver a comprar algo que ya habías pedido antes.

La parte importante no es solo la comodidad. Es el cambio de rol. Chrome deja de ser un simple acceso a internet para convertirse en una especie de intermediario inteligente entre tú y la web.

Eso es enorme.

Porque el navegador sigue siendo una de las puertas principales de acceso a casi todo: compras, búsquedas, comparativas, trabajo, ocio. Si Google consigue que Gemini se convierta en una ayuda natural dentro de Chrome, no solo mejora su IA. También protege uno de sus activos más importantes: el control del acceso al comportamiento digital del usuario.

Google quiere que Gemini esté donde ya pasas tu día

Este punto es clave para entender por qué estas noticias importan tanto.

Mientras otras empresas compiten por tener el mejor modelo o la demo más llamativa, Google está jugando una partida muy distinta: usar su ventaja de ecosistema para meter Gemini dentro de los hábitos diarios de millones de personas.

Tiene sentido:

- ya controlan Gmail,

- Chrome,

- Maps,

- Android,

- YouTube,

- Search.

La jugada lógica no era lanzar otra app más. Era integrar Gemini dentro de todo eso.

Y eso es justo lo que enero mostró. Gemini empieza a aparecer no como un producto aislado, sino como una capa de ayuda permanente que:

- entiende tu contexto,

- recuerda preferencias,

- cruza información,

- automatiza tareas,

- y reduce fricción.

Esta estrategia tiene una ventaja brutal: cuanto más útil sea Gemini dentro de herramientas que ya usas, menos esfuerzo hará falta para que se convierta en costumbre.

La IA pasa de sorprender a volverse hábito

La primera gran ola de IA generativa se basó mucho en el efecto wow: escribir textos, resumir, generar imágenes, resolver dudas. Todo eso sigue siendo importante, pero enero dejó ver que Google ya está pensando en la siguiente fase: la IA como hábito silencioso.

Eso significa que el objetivo ya no es que abras Gemini porque te acuerdas de él. El objetivo es que Gemini esté ahí antes incluso de que pienses en usarlo:

- mientras navegas,

- mientras buscas,

- mientras revisas el correo,

- mientras organizas un viaje,

- mientras estudias.

Ese cambio es muy relevante porque redefine cómo se va a repartir el mercado.

Ya no gana solo quien tenga mejor IA. Gana quien la coloque mejor:

- en el sistema,

- en el navegador,

- en el buscador,

- en la vida cotidiana.

Y Google, por posición, parte con una ventaja muy seria.

También hay una cara delicada: privacidad y dependencia

Claro que este avance también abre preguntas incómodas.

Para que Gemini sea realmente útil y personal, necesita acceso a datos:

- correos,

- historial,

- fotos,

- hábitos de navegación,

- contexto diario.

Google insiste en que todo esto es opcional, configurable y bajo control del usuario. Pero cuanto más útil se vuelve una IA gracias a tus datos, más aparece una tensión inevitable entre comodidad y privacidad.

Y no es un detalle menor. Porque esta nueva fase de asistentes inteligentes ya no se limita a responder. Empieza a observar, anticipar y sugerir. Y eso puede ser muy potente… o demasiado invasivo, según cómo se gestione.

Por eso enero de 2026 fue importante: no solo por las funciones nuevas, sino porque mostró con claridad el tipo de futuro que Google está construyendo. Uno donde Gemini no compite por ser el chatbot más simpático, sino por convertirse en la capa de inteligencia que te acompaña en casi todo lo que haces.

Deja un comentario

Lo siento, tenés que estar conectado para publicar un comentario.